La física cuántica ha desmantelado la idea clásica de un universo hecho de cosas sólidas y separadas, revelando en su lugar un mundo de posibilidades, relaciones y coherencia. Superposición, entrelazamiento, decoherencia y vacío cuántico apuntan a una realidad que se actualiza mediante información y observación. Este capítulo explora cómo estos fenómenos, lejos de ser anomalías, describen la arquitectura profunda del cosmos.

- Introducción

- Superposición y colapso de la función de onda

- El experimento de la doble rendija

- Borrado cuántico

- Entrelazamiento cuántico y no localidad

- Decoherencia cuántica y la frontera de lo real

- La doble rendija y un ejemplo práctico de decoherencia

- Entrelazamiento

- Wolfgang Pauli y Carl Gustav Jung: dos exploradores del límite

- El “efecto Pauli”: cuando el observador altera la realidad

- El vacío cuántico

- El tiempo: entre la física y la consciencia

- Gravedad cuántica: el espacio como red de información

Introducción

Pocas palabras han sido tan maltratadas, tan repetidas y tan poco comprendidas como “cuántico”. Hoy se usa para vender hasta terapias milagrosas, como si invocar ese término bastara para darle legitimidad científica a cualquier cosa. Pero detrás de esa palabra gastada hay algo mucho más fascinante y profundo: una revolución en nuestra comprensión de la realidad que, más de un siglo después, seguimos intentando asimilar.

La física cuántica nació a comienzos del siglo XX casi a regañadientes, como un parche para resolver una crisis: los modelos clásicos ya no explicaban ciertos comportamientos de la materia y la luz. Lo que emergió de aquellos intentos —el trabajo de Planck, Einstein, Bohr, Heisenberg, Schrödinger, Dirac— no solo cambió la ciencia: cambió la idea misma de existencia.

En el mundo cuántico, la materia no es un conjunto de objetos sólidos, sino campos de probabilidad, patrones de información que pueden existir en varios estados simultáneamente. Las partículas dejan de ser pelotas diminutas y se convierten en ondas de posibilidad, entidades que no están “aquí” o “allí”, sino en un rango de potenciales que sólo se concreta cuando se las mide.

La mecánica cuántica no es sólo una teoría, es la estructura más precisa y verificada que la humanidad ha construido. Cada tecnología moderna —los transistores, los láseres, los chips, los relojes atómicos, la resonancia magnética, la computación cuántica incipiente— funciona porque las ecuaciones cuánticas son correctas hasta en sus últimas cifras.

Y sin embargo, esas mismas ecuaciones nos conducen a paradojas que parecen sacadas de un poema zen: la dualidad entre onda y partícula, la superposición, el colapso de la función de onda, el entrelazamiento, la no localidad.

La física cuántica nos obliga a revisar la noción de realidad: no describe un mundo de cosas, sino un mundo de posibilidades que se actualiza solo cuando hay interacción, cuando hay relación, cuando hay información compartida. En ese sentido, el paradigma cuántico encaja de manera natural con la visión que hemos venido explorando: un universo donde la información no es un atributo de la materia, sino su base ontológica.

En este capítulo intentaremos despejar algunas dudas que rodean a la cuántica y explorar con claridad qué significa realmente cada uno de sus pilares. Nos saltamos fórmulas y tecnicismos, y vamos directos a su esencia y a sus implicaciones.

Superposición y colapso de la función de onda

La física clásica nos acostumbró a pensar que las cosas “son” de una forma concreta: una pelota está aquí o allí, una moneda muestra cara o cruz, un planeta orbita por una trayectoria precisa. Pero en el reino cuántico, esa certeza se disuelve.

Una partícula elemental —un electrón, un fotón, un átomo— no ocupa un lugar definido ni posee un estado único mientras no es observada. En cambio, existe como una superposición de posibilidades, una especie de nube de potenciales en la que todos los resultados posibles coexisten al mismo tiempo.

Esa descripción no es metafórica: es literal y está codificada en la función de onda (ψ), el corazón matemático de la mecánica cuántica. La función de onda no nos dice “dónde está” una partícula, sino cuál es la probabilidad de encontrarla en cada lugar o estado.

Antes de medir, todo lo que existe es una distribución de probabilidades, un abanico de opciones abiertas. Solo cuando se realiza la observación —cuando la partícula interactúa con otro sistema, cuando el experimento se registra, cuando la información se actualiza— esa superposición “colapsa” en un resultado concreto.

Este proceso, conocido como el colapso de la función de onda, es uno de los mayores enigmas de la física moderna. ¿Qué hace que, de entre todas las posibilidades, el universo “elija” una sola? ¿Es el acto de medir el que determina la realidad? ¿O simplemente revela una propiedad que ya estaba allí, oculta pero fija? Nadie lo sabe con certeza.

Lo que sí sabemos es que la función de onda describe de forma impecable los resultados de los experimentos. Pero el momento en que una posibilidad se convierte en hecho sigue siendo un misterio.

Algunos físicos, como Niels Bohr y Werner Heisenberg, defendieron la interpretación de Copenhague, según la cual el colapso no necesariamente requiere un proceso físico específico, sino que puede interpretarse como una actualización de nuestra información sobre el sistema. Hay quienes, como Roger Penrose o Eugene Wigner, sospechan que el colapso está ligado a la consciencia misma —que el acto de observar, en un sentido profundo, participa activamente en la creación del resultado.

Sea cual sea la interpretación, el hecho es asombroso: el universo, en su nivel más íntimo, no está compuesto de cosas, sino de posibilidades. Esta perspectiva nos lleva a considerar que la realidad, a su nivel fundamental, no ‘es’ sino que parece ‘devenir’ en el momento de la observación. Algunas interpretaciones recientes sugieren que el colapso podría entenderse como un proceso de actualización en un universo fundamentalmente informacional.

Podríamos decir que la superposición cuántica nos obliga a mirar el mundo no como algo ya definido, sino como un proceso continuo de elección, una actualización constante del posible al real. El colapso no es un accidente ni un misterio sobrenatural, sino la expresión misma de lo que significa existir en un universo informacional: un lugar donde la realidad no está dada, sino que se actualiza al ser conocida. Este quizá sea uno de los puntos más locos y más importantes del modelo informacional: la realidad no es un escenario fijo en el que ocurren cosas, incluídas nuestras vidas, sino que es algo que se crea, que se elige y se actualiza a cada momento.

El experimento de la doble rendija

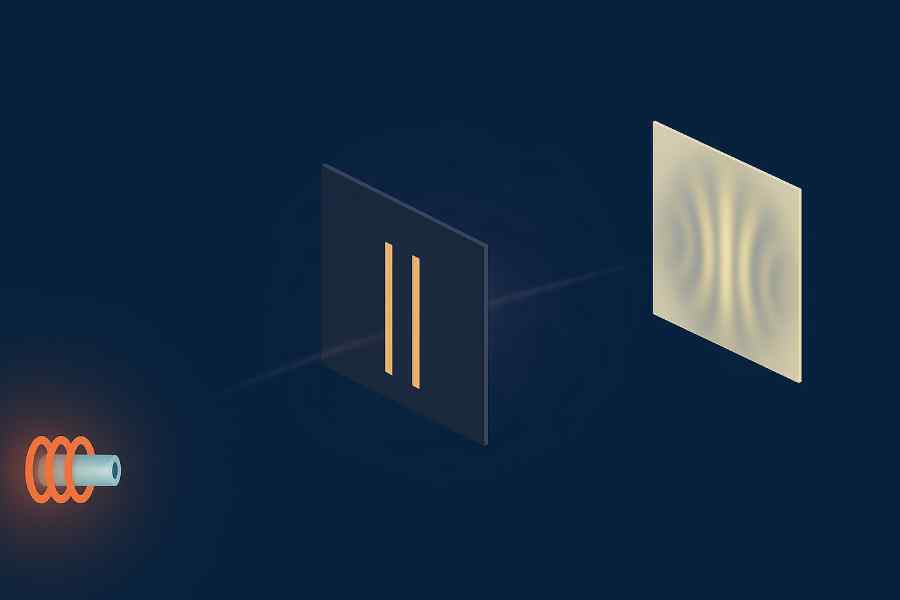

Uno de los experimentos más emblemáticos y desconcertantes de la física cuántica es el experimento de la doble rendija, originalmente planteado por Thomas Young para estudiar la naturaleza de la luz, y posteriormente extendido a partículas como electrones e incluso moléculas más complejas.

El montaje básico consiste en una fuente que emite partículas —pueden ser fotones (partículas de luz), electrones, átomos e incluso moléculas grandes como fullerenos— una a una, dirigidas hacia una pantalla opaca que contiene dos rendijas muy estrechas y próximas entre sí. Tras las rendijas, más adelante, existe una pantalla de detección que puede registrar el punto en el que cada partícula impacta.

Si pensamos en términos estrictamente clásicos, esperaríamos que cada partícula pase por una rendija u otra, de manera que en la pantalla de detección aparezcan dos franjas separadas, correspondiendo a las partículas que pasan por la rendija izquierda o por la derecha, respectivamente. Este resultado sería el esperado para balines lanzados contra una barrera con dos aberturas.

Lo sorprendente aparece cuando se realiza el experimento sin ningún tipo de medición que indique por qué rendija pasó cada partícula. Si se permite que las partículas atraviesen las rendijas de forma totalmente independiente, sin perturbación aparente, y se acumulan los resultados individuales en la pantalla, se observa que no aparecen dos franjas separadas. En su lugar, el patrón registrado corresponde a una serie de franjas claras y oscuras alternas —un patrón de interferencia— exactamente igual al que surge cuando una onda, como el agua o la luz, pasa por ambas rendijas y sus frentes de onda se superponen, generando zonas donde la amplitud se refuerza y otras donde se cancela.

Matemáticamente, este fenómeno se describe utilizando la función de onda cuántica, que asigna una amplitud de probabilidad a cada posible trayectoria de la partícula. La función de onda pasa simultáneamente por ambas rendijas, de modo que las probabilidades asociadas a ambas rutas interfieren: en algunos lugares, las probabilidades se suman (interferencia constructiva), y en otros se anulan (interferencia destructiva). Así, aunque las partículas lleguen de una en una, el patrón acumulado sólo puede explicarse si se acepta que, en alguna forma, “exploran” simultáneamente las dos posibilidades.

Pero la parte verdaderamente enigmática emerge cuando se introduce en el aparato algún dispositivo capaz de registrar, aunque sea mínimamente, cuál de las dos rendijas transitó cada partícula. Puede tratarse de un detector óptico, un sensor electrónico o cualquier aparato que permita, aunque sea en principio, recuperar la información sobre la trayectoria seguida. En ese caso, el patrón de interferencia desaparece por completo: la distribución registrada en la pantalla vuelve a ser la que esperaríamos de partículas clásicas, sin zonas de refuerzo ni cancelación. Es decir, cada partícula aparece asociada a una trayectoria definida, y las franjas características de la interferencia cuántica han desaparecido.

Desde la perspectiva teórica, esto se interpreta como que la interacción con el dispositivo de medida “colapsa” la función de onda en uno de los posibles estados (la partícula pasó por una rendija u otra, pero no ambas), destruyendo la superposición necesaria para que se dé la interferencia. No es imprescindible que un observador consciente examine los datos; basta con que el aparato genere la posibilidad física de recuperar información sobre la trayectoria para que el sistema cuántico deje de comportarse como una superposición y actúe como una partícula clásica.

Este experimento demuestra, de manera simple pero profunda, que en el mundo cuántico la posibilidad de medir —el acceso potencial a información— cambia radicalmente el comportamiento observado en los sistemas físicos, poniendo en jaque las intuiciones clásicas sobre la naturaleza de la realidad. Daos cuenta que este experimento quiere decir que si observamos el mundo éste se presenta de una manera, pero si no lo observamos se presenta de otra.

A raíz de este experimento, surgen preguntas profundas: ¿la realidad existe independientemente de la observación? ¿El acto de medir “crea” los hechos que observamos?

Estas preguntas surgen porque, en la descripción estándar de la mecánica cuántica (la interpretación de Copenhague), el estado de un sistema antes de la medición no consiste en un valor definido para cada propiedad, sino en una superposición de todas las posibilidades permitidas por la función de onda. Sólo en el momento de la medición, cuando hay una interacción que permite “extraer” información de forma física, el sistema adopta de manera irreversible uno de esos valores posibles: se dice que la función de onda “colapsa”.

Otra interpretación adicional es la informacional: Algunos físicos y filósofos, como John Archibald Wheeler, han llevado estas ideas más lejos, proponiendo que el universo entero podría describirse como un proceso informacional donde “el acto de observar” es fundamental. La famosa frase de Wheeler, “el universo participa en su propia existencia”, sugiere que la realidad física no es sólo un escenario preexistente que miramos pasivamente, sino una red dinámica de relaciones en la que cada interacción (cada “medición”) actualiza el estado del universo e incluso contribuye a definir, en sentido fuerte, qué hechos “existen”.

* “The universe does not exist ‘out there,’ independent of us. We are inescapably involved in bringing about that which appears to be happening.”

La idea de Wheeler de un universo ‘participante’ pone el foco en que la realidad no se reduce a un escenario externo que observamos, sino a una red dinámica en la que la consciencia —o al menos el acto de observación— forma parte integral del proceso. En ese sentido, la información no está simplemente “ahí afuera”, sino en la interacción: la existencia del universo y su manifestación dependen, en última instancia, de ese entrelazamiento entre sujeto y mundo.

Borrado cuántico

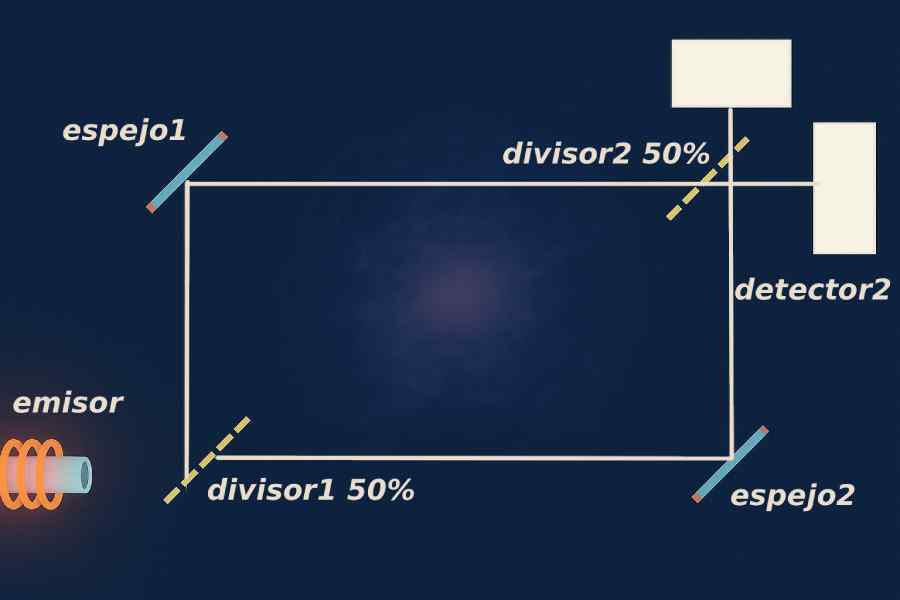

Vamos ahora a darle un apretón de tuerca al experimento de doble rendija. Lo que vemos en la figura es un interferómetro de Mach-Zehnder.

Imaginemos un fotón que abandona su emisor y se dirige hacia un primer divisor de haz, el divisor 1, situado en su camino. Este divisor puede hacer que al 50% los fotones se dirijan por el camino inferior o por el superior. Los espejos no tienen ninguna función más que la de dirigir el haz (cambiar su dirección).

Ambos caminos convergen en la región donde se encuentra un segundo elemento crucial: el divisor 2. Este divisor tiene una característica especial: puede estar o no estar, y esa simple diferencia altera por completo el resultado final.

Si el divisor2 no está presente, entonces los fotones que han recorrido el camino inferior son detectados por el detector superior y los que hayan seguido el camino superior, serán detectados por el detector que está más a la derecha. Hasta aquí lo que tenemos es un comportamiento como partículas, es como en la doble rendija, tenemos información de qué camino ha recorrido la partícula y por tanto no aparecen patrones de interferencia y lo que se dibuja en los detectores son circulitos que es donde incide el corpúsculo.

Ahora bien, si tenemos puesto un segundo divisor (el divisor2), entonces no podemos saber qué camino ha seguido la partícula. El segundo divisor introduce esa incertidumbre, no conocemos el camino, no tenemos la información y por tanto en los detectores ahora lo que se dibuja es un patrón de interferencias.

Hasta aquí el experimento es muy parecido a la doble rendija y las conclusiones que nos da son muy similares con respecto a la naturaleza ondulatoria o corpuscular de las partículas y el hecho de que los resultados son diferentes dependiendo de si tenemos la información o no.

Sin embargo, la verdadera profundidad del experimento aparece cuando uno decide colocar o retirar el divisor 2 después de que el fotón haya atravesado el divisor 1 y esté en camino hacia el dos. Es decir, cuando la decisión que determina si habrá o no interferencia se toma cuando el fotón ya «ha hecho su viaje».

Y aun así, el resultado final depende de esa decisión tardía.

Si el divisor 2 se introduce en el último instante, la interferencia surge como si todo el sistema hubiera estado preparado desde el principio para impedir cualquier conocimiento acerca del camino. Si, por el contrario, se retira, la interferencia desaparece, como si la superposición nunca hubiera existido.

El borrador cuántico revela que, en el dominio microscópico, la realidad no se comporta como una secuencia lineal de causas y efectos, sino como una trama donde la estructura de la información disponible define cómo se manifiestan los fenómenos. La elección de mantener accesible o inaccesible la información de camino no solo condiciona lo que observamos, sino lo que el fotón “es” en el momento de ser detectado. No porque haya cambiado su historia, sino porque su historia nunca estuvo fijada hasta que el conjunto del experimento le otorgó un sentido.

La conclusión no es que el futuro modifique el pasado, sino que en la física cuántica el pasado no adquiere forma definitiva hasta que el sistema global —incluyendo lo que podría saberse— queda determinado. En este experimento, la interferencia es la expresión visible de una verdad más profunda: la realidad cuántica no depende de trayectorias materiales, sino del marco informacional que las hace distinguibles o indistinguibles.

Y ahora el remate. Lo mismo, pero a escala cósmica:

John Archibald Wheeler llevó el borrador cuántico a su conclusión más extrema imaginando un experimento que no se despliega en un laboratorio, sino en el propio universo. Imaginemos un fotón emitido por una estrella lejana, que en su camino hacia la Tierra encuentra una galaxia masiva. Según la relatividad general, la gravedad curva la luz: la galaxia actúa como un gigantesco divisor de haz natural. El fotón dispone ahora de dos rutas posibles para bordear el enorme objeto y seguir su camino hacia nosotros.

Una lente gravitacional es un fenómeno en el que un objeto muy masivo —como una galaxia— curva la trayectoria de la luz que pasa cerca de él. Según la relatividad general, la masa deforma el espacio-tiempo, y la luz sigue esa curvatura igual que seguiría un camino marcado. El resultado es que un mismo objeto lejano puede verse desde la Tierra como si su luz viniera por dos rutas distintas, o aparecer duplicado, ampliado o distorsionado.

La clave es que, miles de millones de años después, ya en la Tierra, los astrónomos pueden elegir entre dos estrategias. Pueden construir un sistema óptico que combine las dos trayectorias y revele un patrón de interferencia, o pueden observarlas de manera separada, distinguiendo cuál de los dos caminos ha seguido el fotón. Lo extraordinario es que el resultado final depende de esta elección tardía. Si las trayectorias se combinan, aparece interferencia: el fotón nunca “eligió” un camino definido. Si se observan por separado, la interferencia desaparece: el fotón parece haber tomado una ruta concreta.

El experimento muestra que el pasado cuántico no es un registro fijo, sino una estructura abierta que se completa únicamente cuando el conjunto del experimento —incluido lo que puede o no puede saberse— queda determinado. La historia del fotón no se decide en el borde de la galaxia, sino en el instante en que la información disponible se estabiliza aquí, en la Tierra. En un sentido profundo, el universo entero funciona como un interferómetro cuya coherencia depende de la información potencial, no del recorrido físico de una partícula diminuta.

El experimento de Wheeler es una manera bonita y exótica de contar lo mismo. Es imposible por la propia naturaleza de esos fotones que han atravesado una lente gravitacional que podamos construir un dispositivo capaz de recomponer la coherencia entre ellos y así obtener patrones de interferencia o no.

Aunque el experimento astronómico imaginado por Wheeler nunca ha podido realizarse en su forma original —donde dos trayectorias cósmicas deberían recombinarse coherentemente—, trabajos modernos como el de Vedovato et al. (2017) muestran que su intuición fundamental sí puede ponerse a prueba mediante otros recursos. En lugar de utilizar dos caminos espaciales separados por distancias astronómicas, este experimento emplea modos temporales de un fotón enviado a un satélite y de regreso, y decide tardíamente si recombinarlos (produciendo interferencia) o distinguirlos (eliminándola). Aunque el mecanismo físico sea distinto, el principio es el mismo: la elección realizada después del viaje del fotón determina si se manifiesta su naturaleza ondulatoria o corpuscular, confirmando que el comportamiento cuántico no depende de una historia fija del fotón, sino de la estructura informacional completa del experimento. El trabajo de Vedovato no replica literalmente el escenario de Wheeler, pero sí respalda su intuición más profunda: la realidad cuántica se define en el momento de la medición y según lo que puede o no puede saberse, incluso cuando el evento de observación ocurre mucho después del proceso que pretendemos describir.

Entrelazamiento cuántico y no localidad

El entrelazamiento cuántico es quizá el fenómeno más inquietante de toda la física moderna. No porque sea extraño —que lo es—, sino porque parece desafiar la noción clásica de localidad y separabilidad. Cuando dos sistemas cuánticos interactúan de forma suficientemente intensa como para compartir un mismo estado físico —por ejemplo, al colisionar, al formar parte de una misma molécula, al emitir un par de fotones desde una misma transición atómica o al ser preparados mediante un proceso de conservación de momento y espín— sus variables quedan correlacionadas de tal manera que ya no pueden describirse por separado. Tras esa interacción inicial, el sistema compuesto posee una única función de onda que incluye a ambas partículas.

A partir de ese instante, incluso si las partículas se alejan millones de kilómetros, siguen formando un único estado cuántico global. Cuando se mide una de ellas, el resultado de la otra queda instantáneamente determinado: no porque haya una señal viajando entre ambas, sino porque nunca dejaron de ser un único sistema descrito por una sola estructura de coherencia. La medición no “afecta a la otra”, sino que actualiza el estado de la totalidad.

Einstein se resistió a aceptarlo. Lo llamó “acción fantasmagórica a distancia”, convencido de que la teoría cuántica debía de estar incompleta. Pero los experimentos realizados a lo largo de cuatro décadas —desde los de Alain Aspect en los años 80 hasta los de Anton Zeilinger, John Clauser y otros, reconocidos con el Nobel en 2022— demostraron que Einstein estaba equivocado. Las predicciones de la mecánica cuántica se cumplen sin fisuras: el entrelazamiento es real, medible y profundamente no local.

“Local” significa que los sucesos en un punto del espacio solo pueden verse afectados por causas situadas en su entorno inmediato, propagándose a lo sumo a la velocidad de la luz. El entrelazamiento viola esa expectativa: los resultados observados en regiones separadas no pueden explicarse de manera independiente ni por ninguna teoría de variables ocultas locales. La única conclusión posible es que las partículas no están realmente separadas: forman un todo coherente descrito por una única función de onda.

Esto no permite comunicación instantánea ni transmisión superlumínica de información, pero sí revela algo más profundo: que el espacio, la distancia y la separación son conceptos derivados, no fundamentales. En el nivel cuántico, la realidad parece comportarse como una estructura continua de correlaciones, una matriz de coherencia donde las distinciones entre “aquí” y “allí” pierden significado ontológico.

En el laboratorio, el entrelazamiento no aparece por arte de magia: se produce mediante interacciones físicas muy concretas que obligan a dos sistemas a compartir un mismo estado cuántico. El procedimiento más común utiliza un cristal no lineal que divide un fotón de alta energía en dos fotones “hijos”. Esta técnica, llamada generación paramétrica espontánea, garantiza que el par conserve exactamente ciertas propiedades combinadas —como el momento angular o la polarización— porque derivan del mismo fotón inicial. Los dos fotones no reciben valores individuales definidos: sólo poseen un estado conjunto, una descripción unitaria que no puede fragmentarse sin destruir el fenómeno.

Otra forma de generar entrelazamiento surge cuando dos átomos o partículas colisionan a bajas energías. En esa interacción, sus funciones de onda se solapan y las amplitudes de probabilidad de cada uno quedan matemáticamente inseparables. Lo importante no es la fuerza del choque, sino que el sistema final conserve cantidades totales (energía, momento, espín) de manera estricta; cuando la física obliga a respetar estas simetrías globales, el resultado natural es un estado compartido que ya no puede descomponerse en partes independientes.

En ambos casos —fotones emparejados o partículas que han interactuado— el patrón es siempre el mismo: la coherencia cuántica que originalmente pertenece a un solo sistema se redistribuye entre dos, creando un estado en el que ninguna partícula posee propiedades propias, solo correlaciones. Separarlas después por kilómetros no rompe ese vínculo; simplemente desplaza las manifestaciones locales de un mismo estado global.

En los experimentos de elección retardada y borrado cuántico, doble rendija y entrelazamiento se necesita un control exquisito de la información disponible en el sistema; basta que una mínima parte del entorno registre algo del “camino” para que la interferencia desaparezca. Por eso estas demostraciones solo funcionan en condiciones extremadamente controladas. No es que la mecánica cuántica deje de operar en sistemas grandes o complejos: es que la información se disipa en el ambiente y la coherencia se pierde. La superposición sigue existiendo en el nivel fundamental, pero se vuelve practicamente imposible de recuperar o medir. En el mundo macroscópico, la decoherencia constante impide que estas sutilezas cuánticas puedan manifestarse, aunque continúen rigiendo todos los procesos en su base.

Decoherencia cuántica y la frontera de lo real

Si uno sigue las ecuaciones de la mecánica cuántica hasta sus últimas consecuencias, debería vivir en un mundo profundamente extraño. Un mundo donde los objetos pueden estar en varios lugares a la vez, donde una partícula puede comportarse como onda, y donde el futuro y el pasado se entrelazan en un baile de probabilidades. Y sin embargo, nuestra experiencia cotidiana no es así. Las cosas son nítidas, sólidas, definidas. Los gatos están vivos o muertos, pero nunca en un estado borroso entre ambos. ¿Qué hace que la realidad que percibimos sea nítida, estable, aparentemente sólida?

La clave está en un concepto relativamente reciente dentro de la física moderna: la decoherencia cuántica. Para entenderla, primero hay que comprender qué significa que un sistema sea coherente.

Cuando un electrón, un átomo o una molécula se encuentra en superposición, las distintas posibilidades que lo describen —estar “aquí” o “allí”, “arriba” o “abajo”— no son independientes: sus ondas están perfectamente sincronizadas. Esa sincronía, llamada coherencia, es la que permite que las probabilidades interfieran entre sí y den lugar a comportamientos cuánticos tan desconcertantes como el patrón de interferencia en el experimento de la doble rendija.

Pero esa armonía es extremadamente frágil. El más leve contacto con el entorno —una molécula de aire, un fotón, una vibración térmica— basta para alterar las fases relativas de esas ondas. El sistema, que antes evolucionaba de forma pura y aislada, empieza a entrelazarse con su entorno, compartiendo información con millones de partículas. Y en ese intercambio, la coherencia se disuelve.

La función de onda no colapsa en el sentido tradicional —no desaparece ni “elige” un estado concreto—, pero las distintas ramas de la superposición dejan de interferir entre sí. Matemáticamente, las fases se mezclan, y el sistema pasa de comportarse como un conjunto de posibilidades superpuestas a parecer un objeto clásico con propiedades definidas. Lo que llamamos “colapso” es, en realidad, la pérdida práctica de coherencia.

El resultado es un límite invisible entre dos mundos. Mientras un sistema cuántico permanezca aislado, la coherencia se mantiene y la realidad conserva su naturaleza ondulatoria. Pero en cuanto ese sistema interactúa con su entorno, se produce la decoherencia: el desvanecimiento de las interferencias que hacen posible la superposición. Y así, el mundo cuántico se transforma —ante nuestros ojos y nuestros instrumentos— en el mundo clásico que percibimos. No es un cambio brusco, sino un proceso gradual que pasa de un estado coherente a otros estados con cada vez menos coherencia.

Un ejemplo ayuda a imaginarlo. Supón que un violinista toca una nota pura en una habitación vacía: el sonido es claro, nítido, coherente. Ahora llena la sala de gente hablando, aplaudiendo, moviéndose. La nota no desaparece, pero se mezcla con el ruido ambiente hasta volverse indistinguible. Eso es la decoherencia: la música cuántica del universo diluyéndose en el murmullo caótico del entorno.

La decoherencia no resuelve todos los misterios —no explica por qué percibimos un resultado concreto y no otro—, pero sí nos muestra por qué no vemos superposiciones en la vida diaria.

En el mundo macroscópico, donde cada objeto está en contacto con miles de millones de partículas, la coherencia cuántica se pierde. Por eso no hay gatos en dos estados ni mesas en superposición de posiciones. La frontera entre lo cuántico y lo clásico no depende del tamaño, sino del grado de aislamiento.

Comprender la decoherencia nos permite distinguir entre la física y sus metáforas. No toda palabra que suene a cuántica lo es…. En las últimas décadas, expresiones como “sanación cuántica”, “curación cuántica” o “pensamiento cuántico” se han popularizado hasta el abuso, intentando trasladar las propiedades del mundo microscópico al ámbito humano, mental o emocional. Pero esa extrapolación carece de fundamento sólido. Las leyes cuánticas solo describen sistemas extremadamente pequeños, aislados y coherentes, como los átomos o las partículas elementales. En el mundo macroscópico —donde todo está en constante interacción— la decoherencia destruye esas superposiciones en una fracción infinitesimal de segundo.

Un cuerpo humano, compuesto por billones de átomos, no puede “colapsar” su realidad con un pensamiento, ni mantener estados cuánticos colectivos estables. La mecánica cuántica describe con precisión un dominio muy específico de la realidad; no legitima interpretaciones más allá de su entorno y menos aún extensiones macroscópicas gratuitas.

La doble rendija y un ejemplo práctico de cómo funciona la decoherencia:

El experimento de la doble rendija no solo revela el misterio de la superposición, sino también el germen de la decoherencia. Cuando una partícula atraviesa el dispositivo sin ser observada, su función de onda mantiene la coherencia: las dos trayectorias posibles —la rendija A y la rendija B— permanecen sincronizadas en fase, y por eso pueden interferir entre sí. En ese estado puro de coherencia, el sistema cuántico conserva toda la información de sus posibilidades, y el resultado es el característico patrón de interferencia: la huella visible de un mundo en el que las alternativas coexisten.

Pero basta con introducir una observación —un detector, una interacción, una mínima transferencia de información— para que todo cambie. En el momento en que el sistema deja de estar aislado, las fases relativas entre las dos trayectorias se dispersan. El entorno registra la información de “por cuál rendija pasó” la partícula, y esa simple adquisición de datos basta para destruir la coherencia. Lo que antes era una superposición se convierte ahora en una mezcla: el patrón de interferencia desaparece, y el mundo se muestra otra vez con nitidez clásica.

Esa transición —de la superposición a la definición, de la coherencia al resultado— es lo que hoy entendemos como decoherencia cuántica. Lo que cambia es el grado de aislamiento del sistema, el flujo de información que lo conecta con el entorno. En la práctica, la frontera entre lo cuántico y lo clásico no está en el tamaño de los objetos, sino en el nivel de interacción informacional. Mientras el sistema conserve coherencia, vive en el reino de las probabilidades; cuando la pierde, emerge el mundo que percibimos.

Así, el experimento de la doble rendija no solo demuestra que la realidad depende de la observación, sino que anticipa el mecanismo que hace posible nuestro universo cotidiano. Cada vez que el entorno registra información, cada vez que la coherencia se dispersa, el universo “elige” una de sus múltiples posibilidades y la convierte en experiencia.

La realidad como acuerdo de coherencia

Durante décadas, el problema del observador en la mecánica cuántica fue un punto ciego, un territorio donde la física se volvía casi metafísica. Pero en los últimos años, varias corrientes teóricas han comenzado a reinterpretar ese misterio en términos de información compartida. Lo que antes se entendía como un “colapso” o una “elección” del universo al ser observado, hoy puede verse como un proceso de comunicación y consenso entre sistemas.

El físico polaco Wojciech Zurek, uno de los pioneros en el estudio de la decoherencia, propuso una idea revolucionaria conocida como darwinismo cuántico. Según su visión, el entorno no destruye la información cuántica: la selecciona, la amplifica y la distribuye. Los sistemas cuánticos interactúan con su entorno de manera que ciertos estados —los más estables, los que mejor “sobreviven” al contacto con el mundo— son replicados una y otra vez. La información de esos estados se propaga en múltiples copias accesibles para diferentes observadores. De ese modo, la realidad que compartimos no surge de una medida mágica, sino de una redundancia informacional: todos accedemos a la misma versión de los hechos porque el entorno se encarga de repetirla hasta el infinito.

Carlo Rovelli, desde una perspectiva diferente, llega a una conclusión compatible. Su interpretación relacional sostiene que no existen estados absolutos ni realidades independientes: todo lo que es, lo es en relación con algo más. La función de onda no describe un objeto aislado, sino una red de relaciones entre sistemas. En esa red, lo que llamamos “mundo clásico” no es un objeto, sino un acuerdo, una forma estable de coherencia compartida. La realidad se convierte así en un fenómeno emergente, no de la materia, sino de las relaciones informacionales entre observadores.

Anton Zeilinger y Časlav Brukner, desde la Universidad de Viena, empujaron la misma intuición hacia una formulación más radical: el universo no está hecho de cosas, sino de información. Lo que existe realmente no son partículas ni campos, sino proposiciones verdaderas sobre el estado de los sistemas, información verificable por observadores. “La información”, escribe Zeilinger, “no es lo que decimos sobre el mundo: es el mundo.”

Y detrás de todos ellos resuena la voz visionaria de John Archibald Wheeler, quien décadas antes había lanzado su provocadora hipótesis: “It from bit.” El ser —el “it”— proviene del bit, del acto de elección informacional que define la realidad entre alternativas posibles. En esta lectura, el universo entero sería una especie de bucle de retroalimentación, donde los actos de observación generan los bits que, a su vez, constituyen la estructura misma del cosmos.

Todas estas ideas convergen en una imagen nueva y sorprendente: la realidad como un consenso informacional, un campo de coherencia compartida que se mantiene mientras los observadores —humanos, instrumentos, fotones, cualquier entidad que registre información— coincidan en los mismos datos. La objetividad no sería entonces un atributo fijo del mundo, sino el resultado de un diálogo cósmico constante, una sincronización entre infinitos nodos de percepción. Lo real no sería lo que está ahí fuera, esperando ser descubierto, sino lo que permanece coherente cuando muchos lo observan desde distintos ángulos.

En esa red de coincidencias, el universo se convierte en un inmenso intercambio de información, una conversación perpetua entre lo que observa y lo observado. Y quizás, al final, lo que llamamos “realidad” no sea otra cosa que eso: el acuerdo dinámico entre consciencias que, al mirar el mundo, lo sostienen en su ser.

Wolfgang Pauli y Carl Gustav Jung: dos exploradores del límite

Pocos encuentros intelectuales del siglo XX han sido tan improbables —y tan fecundos— como el de Wolfgang Pauli y Carl Gustav Jung.

Pauli era uno de los físicos más brillantes y rigurosos de su tiempo, discípulo de Sommerfeld, colega de Einstein y Bohr, y una de las mentes fundadoras de la mecánica cuántica.

A él le debemos el principio de exclusión que explica por qué los electrones no se amontonan en un mismo estado y, por tanto, por qué la materia tiene estructura y estabilidad.

Era un pensador profundamente lógico, con una mente casi quirúrgica para las matemáticas, pero también un hombre atormentado por crisis emocionales y un sentido agudo del misterio.

Su vida se movía entre la precisión de las ecuaciones y la oscuridad de los sueños.

Carl Gustav Jung, por su parte, había roto con Freud para fundar su propia corriente de la psicología profunda, una que entendía la psique no solo como un mecanismo, sino como un sistema simbólico enraizado en lo colectivo y lo arquetípico.

Para Jung, el inconsciente no era un depósito de impulsos reprimidos, sino un vasto territorio compartido por toda la humanidad, donde los mitos, los símbolos y los sueños se entrelazan con las experiencias de la consciencias.

Su visión integraba la ciencia, el arte, la religión y la filosofía: una psicología del alma en su sentido más amplio. En un siglo dominado por el positivismo, Jung se atrevió a afirmar que el mundo interior merecía la misma atención que el mundo exterior.

Dos hombres, pues, que venían de extremos opuestos del conocimiento: Pauli, el físico que buscaba leyes universales; Jung, el psicólogo que buscaba significados universales.

Y sin embargo, ambos compartían una misma inquietud: la sospecha de que la mente y la materia no son dominios separados, sino manifestaciones complementarias de una realidad más profunda, una realidad en la que el orden físico y el orden psíquico podrían resonar al unísono.

El término sincronicidad fue acuñado por Jung para describir un tipo de conexión que no depende de la causalidad, sino del significado. Durante años, Jung había observado que ciertos acontecimientos interiores —sueños, intuiciones, símbolos— parecían coincidir de manera sorprendente con hechos exteriores. No había una relación causa-efecto entre ambos, pero sí una coincidencia significativa, como si ambos brotaran de una misma fuente subyacente.

Para Jung, la sincronicidad era la manifestación de un principio de conexión distinto al causal: un orden acausal, simbólico, donde la mente y la materia responden a una misma estructura de fondo.

En su teoría, la sincronicidad no es una “magia” ni una casualidad caprichosa, sino la señal de que los planos psíquico y físico están alineados por un mismo patrón de sentido.

Cuando una persona sueña con un símbolo y, al día siguiente, ese mismo símbolo aparece de forma inesperada en su entorno, Jung no ve una coincidencia trivial, sino un espejo: la realidad exterior refleja un proceso interior.

Ambos —el suceso mental y el evento físico— serían expresiones paralelas de una realidad unificada, en la que la información se manifiesta tanto en el lenguaje de la materia como en el del alma.

Lo que cambia no es el orden, sino el punto de vista desde el cual lo observamos.

En esta visión, la sincronicidad es una grieta en la aparente separación entre sujeto y objeto, entre observador y mundo.

Cuando ocurre, sentimos que “algo” —más allá de la voluntad, más allá del azar— está organizando la trama de los acontecimientos con una lógica distinta, una lógica simbólica.

Ese algo es lo que Jung llamaba el inconsciente colectivo, un campo psicoide que contiene tanto imágenes como potenciales de forma, y que conecta la interioridad humana con los patrones de la naturaleza.

Es el mismo fondo del que emergen los arquetipos, las formas primordiales del mito y la experiencia.

Con la llegada de Pauli, esta idea adquirió una nueva dimensión.

El físico, acostumbrado a pensar en términos de simetrías y dualidades, reconoció en la sincronicidad un eco de lo que él veía en la física cuántica: una interdependencia profunda entre observador y fenómeno, entre potencialidad y actualización.

Pauli comprendió que la sincronicidad no pretendía explicar sucesos “milagrosos”, sino ofrecer un modelo de relación entre dos órdenes —el psíquico y el físico— que, aunque distintos, podrían compartir una base común de información.

Para él, la sincronicidad era una pista de que la mente y la materia podrían ser dos caras de un mismo proceso, igual que la onda y la partícula son dos manifestaciones de una misma entidad cuántica.

Hoy, desde una mirada contemporánea, la sincronicidad puede reinterpretarse a la luz de teorías más amplias sobre la información, la coherencia cuántica y la emergencia de patrones.

Si el universo es, en su raíz, un entramado informacional, entonces no sería absurdo pensar que los procesos mentales y físicos pudieran sincronizarse bajo condiciones de resonancia o coherencia.

La sincronicidad sería, en ese sentido, una “alineación informacional”: el momento en que distintos niveles de la realidad —interior y exterior— vibran con el mismo patrón de sentido.

No porque haya una causa directa entre ellos, sino porque ambos participan de una misma geometría invisible.

..

El encuentro entre Wolfgang Pauli y Carl Gustav Jung no fue un episodio menor en la historia del pensamiento moderno, sino uno de esos momentos en los que dos mundos —el de la física y el del alma— descubren que se miran desde extremos opuestos del mismo espejo.

Pauli, uno de los físicos más brillantes de su tiempo, había alcanzado fama temprana por su rigor y su carácter ferozmente crítico. Era un hombre de pensamiento afilado, profundamente racional, pero también inquieto y atormentado.

Tras la muerte de su madre y una serie de crisis personales, se vio envuelto en un colapso emocional que lo llevó a buscar ayuda fuera del laboratorio. En 1932, a instancias de amigos y colegas, acudió a la clínica de Jung en Küsnacht.

Aquella decisión, aparentemente terapéutica, se transformó en un experimento intelectual de proporciones cósmicas.

Jung quedó impresionado por la riqueza simbólica de los sueños de Pauli.

El físico tenía visiones recurrentes pobladas de mandalas, figuras geométricas, espirales y espejos: imágenes que Jung reconoció de inmediato como expresiones del inconsciente colectivo.

Pero lo que le sorprendió fue la precisión matemática de esos sueños: estructuras simétricas, rotaciones cuaternarias, correspondencias que parecían traducir los mismos principios de la física a un lenguaje simbólico.

Pauli, por su parte, comprendió que su mente racional y su vida emocional estaban regidas por la misma necesidad de orden y armonía que veía en la naturaleza.

El inconsciente, descubría, no era un caos irracional, sino un campo con leyes propias, una geometría interior.

Durante años, los dos hombres mantuvieron una intensa correspondencia —más de 80 cartas— en la que discutían con una mezcla de erudición, humor y asombro temas como la dualidad onda-partícula, la sincronicidad, el inconsciente colectivo, la simetría y el número como arquetipo del orden.

Ambos creían que existía una zona intermedia entre la física y la psique, un territorio que Jung llamó psicoide y que Pauli identificaba con una “realidad neutra”, más fundamental que la distinción entre materia y mente.

Para ellos, esa zona intermedia era el terreno donde la información —aunque aún no la llamaran así— se convertía en forma, donde el significado adquiría realidad.

Pauli veía en los arquetipos junguianos algo análogo a las simetrías fundamentales de la física: principios de organización que no pertenecen al mundo observable, pero que determinan sus posibles manifestaciones.

Del mismo modo que las ecuaciones de la mecánica cuántica describen potencialidades que solo se actualizan al ser medidas, los arquetipos serían patrones latentes de la psique que se actualizan en sueños, mitos o símbolos.

En ambos casos, lo invisible precede a lo visible, lo potencial da forma a lo real.

El diálogo entre ambos se volvió tan fecundo que Jung llegó a publicar un volumen entero de los sueños de Pauli —El caso del físico—, interpretándolos como un ejemplo de cómo la mente científica puede contactar con el arquetipo del Sí mismo, la totalidad psíquica.

Pauli, por su parte, reconocía que Jung le había ayudado a comprender algo que la física por sí sola no podía enseñarle: que el conocimiento requiere integrar lo racional con lo simbólico, lo objetivo con lo subjetivo.

Decía que “el físico necesita tanto el telescopio como el espejo”, y en su correspondencia se percibe cómo ambos hombres se convirtieron, literalmente, en eso para el otro.

En las cartas finales de su intercambio, Jung confiesa a Pauli que sospecha la existencia de una unidad psico-física, un campo común donde la consciencia y la materia son distintas expresiones de una misma estructura.

Pauli, entusiasmado, responde que algo similar podría deducirse de la física cuántica: el mundo no es una máquina, sino una red de relaciones.

Ambos estaban, sin saberlo, describiendo lo que décadas después otros llamarían teoría de la información, orden implicado o incluso entrelazamiento.

Su amistad fue, en el fondo, una sincronicidad viviente: dos mentes separadas por la ciencia y el símbolo que resonaban en un mismo patrón de búsqueda.

El “efecto Pauli”: cuando el observador altera la realidad

Entre los físicos del siglo XX corría una broma recurrente —y también un leve temor supersticioso—: el “efecto Pauli”. Se decía que cuando Wolfgang Pauli entraba en un laboratorio, los aparatos se rompían. Osciloscopios, detectores, aceleradores… lo que fuera. No importaba el experimento ni la institución: si Pauli estaba cerca, algo fallaba.

La historia se volvió legendaria. En una ocasión, en el laboratorio de Hamburgo, una pieza del ciclotrón se incendió justo cuando se supo que Pauli llegaba en tren. En otra, un interferómetro dejó de funcionar sin causa aparente justo después de que el físico cruzara el umbral. Algunos colegas, medio en broma, medio en serio, pedían que no asistiera a las pruebas más delicadas.

Pauli, que tenía un sentido del humor agudo y un punto de ironía trágica, no solo no lo negaba, sino que alimentaba el mito. Llegó a decir:

“No necesito entrar en el laboratorio; basta con acercarme lo suficiente para que los experimentos colapsen”.

La frase, aunque dicha con sorna, parecía encapsular de forma casi poética la esencia de la mecánica cuántica: la idea de que el observador no es un elemento neutro, sino que su mera presencia —su “interacción informacional”, diríamos hoy— puede modificar el resultado del experimento.

El episodio más repetido cuenta que, en el Instituto de Física de la Universidad de Göttingen, un experimento falló de manera inexplicable justo cuando Pauli se encontraba viajando en tren por las cercanías.

Cuando los investigadores comentaron el desastre más tarde, alguien bromeó:

“Seguro que Pauli estaba pasando por aquí en ese momento”.

Y, según el relato, al verificar su itinerario, efectivamente el tren en el que viajaba Pauli había pasado por debajo del laboratorio justo en ese instante.

No hay registro verificable del incidente, pero fue relatado por varios contemporáneos de Pauli, incluido Werner Heisenberg, que lo mencionó en sus memorias (Physics and Beyond, 1971) como un ejemplo de la “fama casi mágica” de su colega.

Heisenberg decía que el mito del “Efecto Pauli” era tan extendido que incluso algunos experimentadores se negaban a realizar pruebas si sabían que Pauli estaba en la ciudad.

Así que, aunque no puede demostrarse históricamente que el experimento fallara exactamente cuando el tren pasaba, la anécdota es auténtica como mito vivo, transmitida y creída —al menos en tono de broma— por la comunidad científica de la época.

Cuando conoció a Jung, el psicólogo suizo no tardó en interesarse por esa reputación casi mística. Jung veía en el “efecto Pauli” un ejemplo vivo de sincronicidad, esa coincidencia significativa entre eventos interiores (la psique) y exteriores (la materia) que no tienen relación causal aparente, pero sí una conexión de sentido. Para Jung, no era tanto que Pauli “estropeara” máquinas, sino que su campo psíquico y el entorno parecían resonar en patrones comunes.

Pauli, que no creía en los milagros pero tampoco en las coincidencias ciegas, no desestimó del todo la idea. De hecho, ambos discutieron largamente sobre si tales eventos podrían ser manifestaciones de una unidad subyacente entre mente y materia. En una de sus cartas, Pauli bromea con Jung:

“Quizá el universo no soporta la tensión cuando dos observadores tan distintos se acercan demasiado. Las ecuaciones pierden la coherencia”.

Detrás del humor, sin embargo, había una intuición profunda. Para ambos, esas coincidencias no eran supersticiones, sino señales de un orden más amplio, de una interconexión invisible que atraviesa los dominios de la física y la psique.

El “efecto Pauli” se convirtió así en un símbolo de su diálogo: un guiño del cosmos recordando que la realidad puede ser más sensible —y más participativa— de lo que sospechamos.

En el fondo, el laboratorio que se descompone ante su presencia era solo una metáfora del universo entero: un sistema tan delicadamente entrelazado que la consciencia, el pensamiento o la expectativa de un solo observador podrían bastar para alterar su curso.

El vacío cuántico

En la física moderna, el término vacío ya no significa ausencia de todo, sino el estado más bajo de energía posible de un campo cuántico. Cada tipo de partícula —fotones, electrones, quarks, gluones— está asociado a un campo que llena todo el espacio, y aunque no haya partículas reales presentes, esos campos nunca están completamente en reposo. Debido a las leyes de la mecánica cuántica, el campo siempre conserva una mínima agitación residual: el llamado vacío cuántico.

Estas oscilaciones no son un fallo del modelo, sino una consecuencia directa del principio de incertidumbre de Heisenberg. Dicho principio impide que un sistema tenga simultáneamente energía y tiempo de duración perfectamente definidos; por eso, incluso en su estado de mínima energía, un campo cuántico “fluctúa”. En esas fluctuaciones, pares de partículas y antipartículas aparecen y desaparecen constantemente, aunque su existencia sea tan breve que no pueden detectarse directamente.

El vacío cuántico no se “crea” ni se “destruye”: es el estado base del universo. Todo lo que existe —materia, radiación, estructuras— se sostiene sobre ese fondo. Incluso en regiones del espacio intergaláctico donde parece no haber nada, el vacío cuántico sigue activo. En laboratorio, los físicos pueden eliminar casi todas las partículas y enfriar el sistema hasta fracciones de grado por encima del cero absoluto, pero nunca se alcanza un vacío absoluto; el fondo cuántico persiste.

Aunque esta idea nació como una necesidad teórica dentro de la mecánica cuántica, hoy se considera una realidad física comprobada. Varias observaciones experimentales han mostrado efectos directos o indirectos del vacío cuántico sobre la materia.

Uno de los más conocidos es el efecto Casimir. En 1948, los físicos Hendrik Casimir y Dirk Polder predijeron que si se colocan dos placas metálicas paralelas muy próximas entre sí —a una distancia del orden de micrómetros—, las fluctuaciones del vacío entre ellas se ven limitadas. Fuera de las placas, los modos de vibración del campo son más abundantes; dentro, algunos modos no caben. Esa diferencia crea una presión neta que empuja las placas una hacia la otra. Décadas después, con instrumentos de precisión nanométrica, el efecto fue medido y confirmado. Hoy se considera una de las pruebas más claras de que el vacío cuántico ejerce fuerzas reales y cuantificables.

Otro caso relevante es el efecto Lamb, descubierto en 1947 por Willis Lamb y Robert Retherford. Al estudiar el espectro del átomo de hidrógeno con gran precisión, observaron un pequeño desplazamiento en las líneas energéticas de los electrones que la teoría clásica no preveía. La explicación vino del vacío cuántico: los electrones interactúan con las fluctuaciones del campo electromagnético, lo que altera ligeramente sus niveles de energía. El efecto Lamb fue una confirmación decisiva de la electrodinámica cuántica y del papel físico del vacío.

Un tercer fenómeno, todavía más extremo, es la radiación de Hawking. Stephen Hawking demostró teóricamente en 1974 que las fluctuaciones del vacío cerca del horizonte de un agujero negro pueden generar pares de partículas y antipartículas. Normalmente, ambas se aniquilan en un instante, pero si una de ellas cae dentro del agujero negro y la otra escapa, se produce una emisión neta de radiación. Con el tiempo, ese proceso implicaría la pérdida gradual de masa del agujero negro, un resultado sorprendente que unifica conceptos de relatividad, mecánica cuántica y termodinámica. Aunque la radiación de Hawking aún no ha sido observada directamente en el cosmos, existen simulaciones experimentales en laboratorios con sistemas ópticos y fluidos cuánticos que reproducen efectos análogos.

Estos ejemplos muestran que el vacío cuántico no es una abstracción teórica: es un medio físico con propiedades medibles. Su energía influye en la materia, en las fuerzas y posiblemente en la evolución cósmica. Algunos físicos incluso sugieren que la llamada energía oscura —la responsable de la aceleración en la expansión del universo— podría estar relacionada con la energía del vacío, aunque su magnitud exacta sigue siendo un problema abierto: los cálculos teóricos del vacío dan un valor inmensamente mayor que el observado en la realidad, una de las discrepancias más notables de la física actual.

Más allá de su interpretación energética, varios autores plantean que el vacío cuántico puede entenderse también como un campo de información latente. En él, las leyes físicas, las constantes y las simetrías del universo estarían codificadas como condiciones estructurales. Cuando se producen fluctuaciones y aparecen partículas reales, lo que en realidad emerge es una configuración particular de esa información. Desde esta perspectiva, el vacío cuántico no es un fondo pasivo, sino la matriz que contiene todas las posibilidades de existencia física.

En última instancia, el vacío cuántico puede entenderse como la expresión física de una potencialidad no material. Allí donde aparentemente no hay nada, las observaciones experimentales muestran que existe un campo activo, capaz de generar energía, partículas y fuerzas a partir de sus fluctuaciones. Ese fondo universal contiene la información estructural del cosmos: las reglas, constantes y simetrías que permiten la existencia de la materia. En otras palabras, el vacío no es ausencia, sino una forma de presencia fundamental: el registro informacional del que emergen todos los fenómenos observables. Lo material, entonces, no sería más que la actualización temporal de esa información latente, el resultado de perturbaciones en el mismo tejido cuántico que constituye el espacio tridimensional.

El tiempo: entre la física y la consciencia

El tiempo es, probablemente, el fenómeno más cotidiano y al mismo tiempo el más difícil de definir. Todos lo experimentamos: sentimos su fluir, lo medimos, lo tememos. Pero cuando la física intenta describirlo con precisión, el concepto se vuelve resbaladizo. Lo que para la experiencia humana parece un río que avanza del pasado hacia el futuro, para la ciencia moderna se presenta como algo mucho más complejo y, en algunos enfoques, incluso ilusorio.

En la física clásica, el tiempo era una magnitud absoluta. Para Newton, el tiempo fluía de forma uniforme, igual para todos los observadores, independiente del espacio y de los acontecimientos. Era un escenario neutro donde las cosas ocurrían, pero él mismo permanecía inmutable. Esa idea cambió radicalmente con la teoría de la relatividad de Einstein. Espacio y tiempo dejaron de ser entidades separadas para fundirse en una única estructura: el espacio-tiempo. En ese marco, el tiempo no es universal. Puede dilatarse o contraerse dependiendo de la velocidad o del campo gravitatorio. Dos observadores pueden medir duraciones distintas entre los mismos sucesos, y ambos tener razón. En este sentido, el tiempo deja de ser una corriente única y se convierte en una propiedad local del universo.

La física cuántica llevó esa ruptura todavía más lejos. En la mecánica cuántica estándar, el tiempo suele tratarse como un parámetro externo, distinto de los observables físicos del sistema. Sin embargo, en teorías más avanzadas, la naturaleza del tiempo se torna más compleja y su papel puede variar.

Las ecuaciones describen cómo cambia el estado de un sistema “en función del tiempo”, pero no explican qué es el tiempo en sí. En algunos enfoques de la gravedad cuántica, como la ecuación de Wheeler-DeWitt, el tiempo convencional no aparece explícitamente en la formulación; el universo podría describirse como una red de relaciones atemporales. Sin embargo, esta visión es objeto de debate y depende del marco teórico adoptado.

El universo se describe entonces no como algo que “evoluciona”, sino como una totalidad estática, una red de relaciones atemporales entre estados posibles. En este nivel, no existe un “antes” ni un “después”: todo está dado a la vez, y el tiempo sería una propiedad emergente que aparece solo en ciertos contextos o desde el punto de vista de determinados observadores.

Desde la cosmología, el tiempo cumple una función descriptiva más que ontológica. En el modelo del Big Bang, el tiempo es la medida de la expansión del universo y de sus etapas: la nucleosíntesis, la formación de las galaxias, la aparición de la vida. Pero este “tiempo cósmico” es un parámetro de la evolución, no necesariamente una sustancia real. En cambio, en las teorías cuánticas de la gravedad, la idea dominante es que el tiempo no es fundamental: surge como una consecuencia de cómo los sistemas organizan la información. Lo que experimentamos como “paso del tiempo” sería, en el fondo, una forma de ordenar y correlacionar estados dentro de un universo que, en su raíz, podría ser atemporal.

La neurociencia aporta evidencia de que la percepción del tiempo es una construcción del cerebro, basada en integrar señales diversas. Aunque esto no implica necesariamente que el tiempo físico sea emergente, sí muestra que nuestra experiencia temporal es, en parte, una interpretación cognitiva. Cada instante de consciencia es el resultado de integrar señales que llegan en momentos distintos —como el sonido y la luz de un relámpago— y presentarlas como simultáneas. Para lograrlo, el cerebro utiliza una “ventana temporal” de unos cientos de milisegundos donde agrupa los estímulos y los convierte en una experiencia coherente. El presente, por tanto, no es un punto objetivo del tiempo físico, sino una construcción mental que organiza información para mantener la continuidad de la experiencia.

Desde la física teórica y la filosofía de la mente, esta relación entre tiempo e información adquiere un papel central. Si la realidad última es un conjunto de estados informacionales atemporales —un registro de todas las configuraciones posibles del universo—, entonces el tiempo sería la forma en que la consciencia recorre ese espacio de posibilidades. La sensación de fluir del pasado al futuro equivaldría a la lectura secuencial de una base de datos cósmica. Nada “pasa” en sentido físico; lo que cambia es la porción de información a la que el observador tiene acceso en cada momento.

En la relatividad, esta idea se formaliza en el llamado “bloque del universo”: un modelo en el que pasado, presente y futuro existen simultáneamente dentro del espacio-tiempo. La totalidad del universo sería como una estructura completa y fija, donde todos los acontecimientos —desde el nacimiento de una estrella hasta la lectura de estas líneas— ya están contenidos. La consciencia, sin embargo, no puede abarcar ese bloque completo, sino que experimenta solo una delgada franja móvil: el presente. El “fluir del tiempo” no sería una propiedad del universo, sino de la percepción.

Incluso los estados alterados de consciencia —como la meditación profunda, los sueños o ciertas experiencias inducidas por fármacos— confirman la naturaleza constructiva del tiempo mental. En ellos, la duración subjetiva puede expandirse, contraerse o desaparecer por completo. Si el tiempo fuera una propiedad física inmutable, eso no sería posible. Pero si es una función del procesamiento de información, entonces tiene sentido: cambiar el ritmo o la forma de procesar la información cambia también la experiencia del tiempo.

Desde el punto de vista informacional, el tiempo sería una herramienta para organizar la experiencia dentro de un universo atemporal. La consciencia actuaría como un agente que selecciona, interpreta y secuencia estados de información, generando una narrativa coherente de causa y efecto. Sin esa secuenciación, no habría experiencia ni memoria; todo existiría simultáneamente, pero sin sentido. En cambio, al ordenar la información, la consciencia convierte el potencial en historia, el caos en experiencia.

En síntesis, la física moderna y la teoría de la información coinciden en una idea fundamental: el tiempo no es una sustancia ni un flujo real, sino una propiedad emergente, un modo de organización. El universo, en su nivel más profundo, podría ser atemporal —una estructura de información pura—, y el tiempo, la forma en que la consciencia navega esa estructura, traduciéndola en experiencia. El presente sería, entonces, el punto de contacto entre la información potencial y su interpretación consciente: el lugar donde el ser y el saber se encuentran.

En última instancia, el tiempo puede entenderse como una propiedad emergente ligada a la existencia de una consciencia capaz de procesar información. En un universo puramente informacional, donde todos los estados posibles coexisten, no hay un antes ni un después: todo está disponible simultáneamente. Es la consciencia la que, al interactuar con ese conjunto de datos, establece una secuencia, una narrativa coherente de estados que interpretamos como pasado, presente y futuro. El tiempo surge, entonces, como el resultado de leer y ordenar información dentro del campo de posibilidades. Cada acto de percepción selecciona un estado y lo integra con el anterior, construyendo la sensación de continuidad. Desde esta perspectiva, el tiempo no es una sustancia física ni un flujo universal, sino una función cognitiva emergente: el modo en que la consciencia convierte la información estática del universo en experiencia dinámica.

Gravedad cuántica: el espacio como red de información

La gravedad es una de las cuatro fuerzas fundamentales del universo, junto con el electromagnetismo y las fuerzas nucleares fuerte y débil. Es la responsable de que los objetos caigan al suelo, de que los planetas giren alrededor del Sol y de que las galaxias permanezcan unidas. En la escala cotidiana, es la fuerza más familiar; en la escala cósmica, la que estructura el universo.

De Newton a Einstein

Isaac Newton la describió en el siglo XVII como una fuerza de atracción entre cuerpos con masa. Su ley de gravitación universal permitió explicar el movimiento de los planetas, las mareas y la caída de los cuerpos. En su visión, el espacio y el tiempo eran absolutos: un escenario fijo e inmutable donde ocurrían los fenómenos físicos.

Dos siglos después, Albert Einstein revolucionó este concepto. En su teoría general de la relatividad (1915), mostró que la gravedad no es una fuerza en el sentido clásico, sino la manifestación de la curvatura del espacio-tiempo causada por la masa y la energía. Los cuerpos no son “empujados” por una fuerza invisible; simplemente siguen trayectorias naturales (geodésicas) dentro de una geometría deformada. Esta idea explicaba fenómenos que Newton no podía prever, como la desviación de la luz por la gravedad o la ligera variación en la órbita de Mercurio.

La relatividad funciona perfectamente a gran escala —planetas, estrellas, galaxias—, pero no se integra bien con la mecánica cuántica, que describe el comportamiento del mundo microscópico.

El desafío de unir lo grande y lo pequeño

En las escalas más pequeñas imaginables —cercanas a la longitud de Planck, unos 10⁻³⁵ metros—, la estructura del espacio-tiempo parece volverse discontinua y turbulenta. Las fluctuaciones cuánticas podrían distorsionar el espacio mismo. Sin embargo, la relatividad general trata ese espacio como un tejido continuo y suave. Ambas descripciones, aunque exitosas en sus dominios, se contradicen cuando se aplican simultáneamente.

Esa incompatibilidad es el punto de partida de la gravedad cuántica, una teoría que busca unificar la relatividad y la mecánica cuántica. Pretende describir qué ocurre con el espacio y el tiempo cuando los efectos cuánticos no pueden ignorarse: en el interior de un agujero negro, en los primeros instantes del Big Bang o en cualquier región donde la energía y la curvatura del espacio-tiempo sean extremas.

Loop Quantum Gravity (LQG): el espacio no es continuo

Una de las principales propuestas para resolver este problema es la Gravedad Cuántica de Bucles (Loop Quantum Gravity, LQG). Su planteamiento parte de una idea simple pero profunda: el espacio no es un continuo, sino una red discreta formada por unidades mínimas de volumen y área.

Según esta teoría, existen “átomos de espacio”, llamados quanta, que constituyen la textura fundamental del universo. Estos quanta se conectan formando redes de espín (spin networks), estructuras matemáticas que describen cómo se entrelazan las unidades básicas del espacio.

En este modelo, las áreas y volúmenes no pueden variar de forma continua; solo pueden adoptar valores específicos, del mismo modo que la energía en los átomos está cuantizada. A escalas enormes, estas redes producen la ilusión de un espacio continuo, igual que los píxeles de una pantalla parecen formar una imagen lisa cuando se los mira de lejos.

La Loop Quantum Gravity no parte de un espacio preexistente: el propio espacio-tiempo surge de las relaciones entre los elementos de la red. En otras palabras, el espacio no es un escenario donde ocurren las cosas, sino un resultado emergente de cómo se organiza la información entre los quanta.

Evidencias y aplicaciones teóricas

Aunque la LQG aún no tiene confirmación experimental directa, ofrece explicaciones coherentes para varios problemas cosmológicos. Por ejemplo, algunos modelos basados en esta teoría sugieren que el Big Bang podría no haber sido una “singularidad” (un punto de densidad infinita), sino un rebote cuántico: una fase de contracción previa seguida de expansión, en la que la gravedad cuántica impide el colapso total del espacio.

Otros trabajos relacionan la LQG con los agujeros negros. En lugar de singularidades, estos serían regiones donde la información queda comprimida en la estructura de la red de espín, lo que podría explicar el origen de la entropía de los agujeros negros y su posible evaporación.

El espacio como red de información

En la Gravedad Cuántica de Bucles, el espacio no es un fondo continuo, sino una malla discreta formada por nodos y enlaces que codifican áreas, volúmenes y relaciones geométricas mínimas. Esta red de espín constituye la textura fundamental del universo y, según la teoría formal, de su dinámica emergen tanto la geometría como el tiempo. Sin embargo, aunque esta estructura pueda describirse matemáticamente como un entramado de relaciones, la LQG no afirma que estas relaciones sean información en un sentido ontológico. La descripción estricta habla de estados cuánticos y operadores geométricos; la interpretación informacional es una extensión conceptual que algunos autores han explorado, pero no pertenece al consenso estándar de la teoría.

Aun así, el carácter relacional de la LQG —el hecho de que nada exista como “punto” aislado, sino sólo como nodo definido por sus conexiones— invita naturalmente a pensar el espacio como un sistema que organiza diferencias, correlaciones y patrones. Desde esa perspectiva, es legítimo sugerir, como hipótesis filosófica, que la red fundamental puede concebirse también como un soporte informacional: un dominio donde lo que existe son configuraciones y transiciones entre estados posibles. Es una lectura compatible con el formalismo, aunque no requerida por él.

La introducción de la consciencia como operador de coherencia pertenece exclusivamente al marco interpretativo de este libro. La LQG no asigna ningún papel ontológico al observador ni lo considera un agente que actualiza estados; su tratamiento es puramente físico. Pero si adoptamos la tesis informacional propuesta aquí —según la cual la consciencia no crea la realidad desde fuera, sino que la actualiza al establecer relaciones coherentes dentro de un campo de posibilidades—, entonces la LQG ofrece un paralelo poderoso: un universo en el que lo fundamental no son los objetos, sino las relaciones; no los lugares, sino las interacciones; no la geometría dada, sino la coherencia que emerge de su dinámica.

Desde esta lectura ampliada, la red de espín podría verse como una matriz de potencialidades y la consciencia como la actividad que selecciona, estabiliza y hace manifiestas ciertas configuraciones entre todas las posibles. La física, por su parte, describe la estructura matemática de esa red; la interpretación informacional y consciente propone un significado ontológico para ella. Ambas visiones no se contradicen: se sitúan en niveles distintos. Y su convergencia sugiere una intuición profunda —que el espacio-tiempo no sea una sustancia que existe por sí misma, sino un patrón relacional cuya estabilidad depende, en último término, de la coherencia con la que la información fundamental se organiza y se interpreta.

Avance

La decoherencia fija qué posibilidades cuánticas se estabilizan en forma de realidad observable: una vez que la información de un sistema se dispersa en el entorno, las demás alternativas dejan de ser recuperables. Pero este límite no es solo físico; también es perceptivo. Cada tipo de consciencia solo puede acceder a la porción de información para la que su estructura biológica y cognitiva está configurada, igual que un receptor que solo sintoniza ciertas frecuencias dentro de un espectro más amplio.

Esto significa que la experiencia ordinaria registra únicamente la información ya colapsada, aquella que el entorno ha estabilizado en un solo resultado posible. Sin embargo, hay indicios —tanto psicológicos como contemplativos y fenomenológicos— de que ciertos estados alterados de consciencia permiten acceder a formas de información más amplias, menos definidas y aún no completamente colapsadas. En esos estados, la percepción podría abrirse a patrones coherentes del campo informacional que normalmente quedan fuera del alcance de la mente en condiciones habituales.

En capítulos posteriores desarrollaremos un modelo que explica estas diferencias de acceso: un marco donde la realidad emerge de la interacción entre información fundamental y consciencia, y donde cada forma de vida sintoniza un nivel distinto de ese campo. La decoherencia no solo delimita el comportamiento físico de los sistemas, sino también el rango de realidad que una consciencia concreta puede percibir.

"En Él vivimos, nos movemos y existimos.”

— Hechos 17:28